KNOWLEDGE MAKES THE WORLD GO ROUND ®

Das Jahr 2025 neigt sich dem Ende zu, und es ist Zeit, das Jahr Revue passieren zu lassen. Dazu zählt natürlich auch, einige Zahlen zu unserem Blog und zu den Aktivitäten in Sozialen Medien zusammenzustellen.

Um es gleich vorweg zu sagen: Uns geht es dabei nicht alleine um Reichweite, sondern um Qualität. Alle Blogbeiträge enthalten daher Quellenangaben, sodass klar wird, was aus der Quelle stammt, und was unsere Meinung dazu ist. Darüber hinaus haben wir uns von Anfang an entschiedenen, unseren Blog ohne nervige Werbung anzubieten.

Durch diese Arbeitsweise haben wir von Anfang an auf Vertrauen gesetzt. Genau das macht unseren Blog in der Zwischenzeit zu einem Qualitätsprodukt, das sich von der massenhaften Produktion von Content durch Künstliche Intelligenz unterscheidet.

Es ist toll zu sehen, dass unsere Blogbeiträge und Themen auch im Jahr 2025 beachtet wurden. Die folgenden Zahlen sollen das verdeutlichen:

Insgesamt finden Sie bei uns jetzt 4.377 Blogbeiträge. Davon sind 288 im Jahr 2025 hinzugekommen.

Beiträge wurden in diesem Jahr knapp 45.000 mal aufgerufen – JetPack-Statistik in WordPress.

Die Anzahl der Besucher wieder ein hohes Niveau erreicht : 20.000 Besucher aus dem In- und Ausland sind an unseren Blogbeiträgen interessiert – JetPack-Statistik in WordPress.

Bei LinkedIn besteht mein Netzwerk aktuell aus 736 Kontakten.

Bei Facebook habe ich 345 Follower und Jutta 1.680 Freunde.

Mein X-Account (vormals Twitter) hat aktuell 1.207 Follower, wobei das nicht unserer bevorzugter Kanal ist.

Wir sehen diese Zahlen als Ansporn, auch im Neuen Jahr 2026 auf allen Kanälen weiterhin aktiv zu sein.

Wenn es um KI-Agenten geht, wird oft darüber diskutiert, wie das entsprechende Design aussehen sollte, damit der oder die KI-Agenten die wirtschaftlichen Ziele erreichen können. In dem Zusammenhang gibt es immer wieder Hinweise darauf, dass solche gut gemeinten KI-Agenten oftmals unbeabsichtigte Folgen nach sich ziehen können. Die folgende Quelle aus 2025 stellt das unmissverständlich dar:

„When it comes to AI agents, even well-intentioned design can lead to unintended consequences. The challenge isn’t just about making agents work correctly – it’s is about making them work safely and ethically within a complex ecosystem of human and artificial actors“ (Bornet, P. et al. 2025).

Wie vom Autor hervorgehoben, ist es eine der wichtigsten Herausforderungen, dass KI-Agenten sicher und ethisch in einem komplexen Ökosystem von Menschen und „künstlichen Akteuren“ arbeiten.

Ethisch bedeutet hier, innerhalb eines gesellschaftlich akzeptierten Wertesystems – beispielsweise des Wertesystems der Europäischen Union.

In der Softwareentwicklung war es schon früh klar, dass Projekte mit unklaren Anforderungen anders abgewickelt werden müssen, als gut planbare Projekte. Aus diesen Überlegungen heraus hat sich das Agile Manifest ergeben, und haben sich verschiedene Vorgehensmodelle entwickelt, wie z.B. KANBAN in der IT, Scrum oder auch Design Thinking.

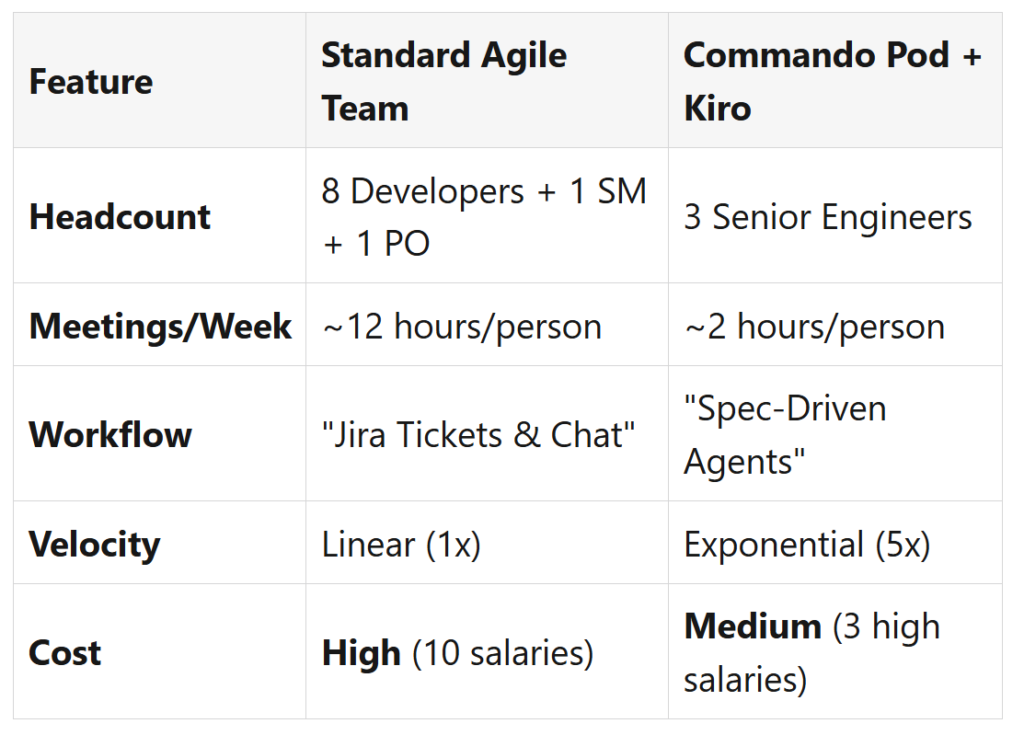

Es wundert weiterhin nicht, dass Künstliche Intelligenz rasch in der Softwareentwicklung – z.B. auch im Scrum Framework – angewendet wurde, und auch noch wird. An dieser Stelle wird klar, dass bestehende Prozesse mit KI effizienter durchgeführt werden sollen. In dem Beitrag von Montagne (2025) wird in Bezug auf eine McKinsey-Studie erwähnt, dass durch diese Vorgehensweise durchaus Produktivitätsvorteile in Höhe von 10-15% erzielt werden können.

„Old Model (Standard Agile + AI): ~10-15% productivity gain“ (ebd.).

Demgegenüber weist Montagne allerdings auch darauf hin, dass durch eine andere Vorgehensweise – also ohne das Scrum Framework – plus KI ganz andere Produktivitätsvorteile erzielt werden können.

„New Model (Small Pods + Agentic Workflows): Transformational gains (500%+)“ (ebd.).

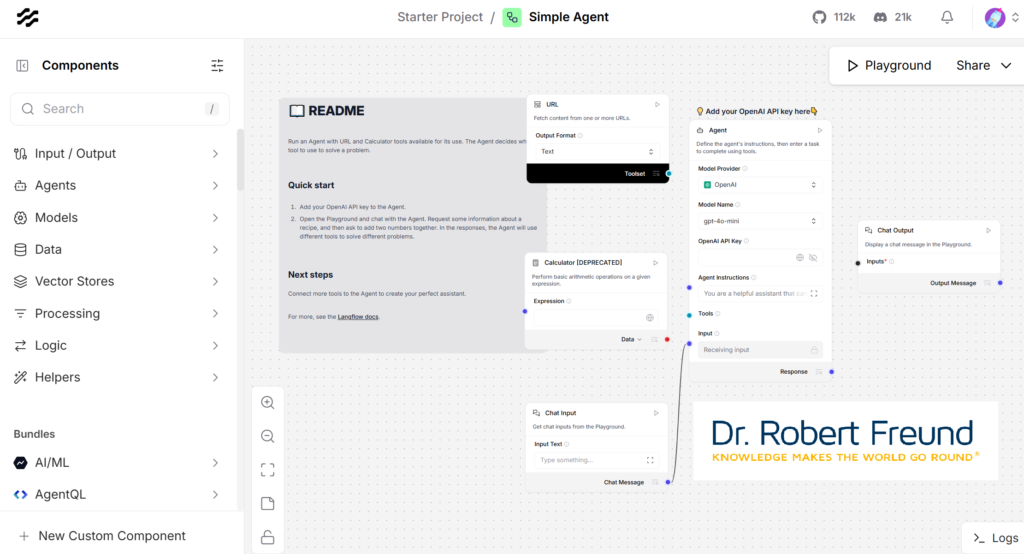

Die Abbildung weiter oben zeigt in der Gegenüberstellung die immensen Vorteile einer Vorgehensweise, die sich von Scrum unterscheidet und Agentic AI mit Kiro nutzt.

Es stellt sich natürlich gleich die Frage, ob dieses Learning aus der Softwareentwicklung auch auf andere Bereiche übertragbar ist. Antwort: Ja, das ist es.

In dem Blogbeitrag Warum wird GESCHÄFTSMODELL + AI nicht ausreichen? habe ich die Gründe dafür beschrieben.

Wenn es um den Nutzen, oder den Wert, eines Produktes oder einer Dienstleistung geht, sollten grundsätzlich zwei Punkte beachtet werden.

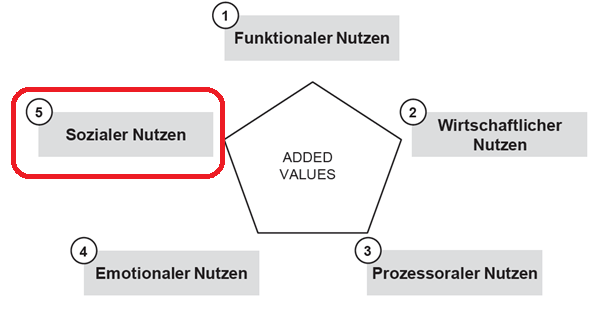

(1) Die verschiedenen Dimensionen von Nutzen (Added Values)

In der Abbildung ist zu erkennen, dass Added Values fünf Dimensionen beinhalten. Neben dem funktionalen Nutzen, sind das natürlich der wirtschaftliche Nutzen, ein prozessoraler Nutzen und ein emotionaler Nutzen, Die Dimension, die stärker in den Fokus rücken sollte, ist der soziale Nutzen (eigene Hervorhebung in der Abbildung). Am Beispiel der Anwendung von Künstlichen Intelligenz wird deutlich, dass der Fokus in der aktuellen Diskussion zu sehr auf dem wirtschaftlichen Nutzen liegt, und zu wenig den sozialen Nutzen thematisiert.

(2) Nutzen, Wert und Werte

Bei einer ausgewogenen Betrachtung zur Nutzung Künstlicher Intelligenz auf der persönlichen Ebene, auf der Team-Ebene, auf der organisationalen Ebene oder auf gesellschaftlicher Ebene können Werte als Ordner dienen. „Der Begriff »Werte« unterscheidet sich vom Begriff »Wert« dadurch, dass der erste Begriff die Gründe beschreibt, warum etwas für jemanden wichtig ist. Werte repräsentieren normative Grundlagen, die als Leitprinzipien für individuelles Verhalten und gesellschaftliche Strukturen dienen. Sie bilden die Basis für die Bewertung von Wert und beeinflussen die Art und Weise, wie Individuen und Gesellschaften Güter, Dienstleistungen oder Handlungen priorisieren“ (Hämmerle et al. 2025, Fraunhofer HNFIZ).

Siehe dazu auch

Künstliche Intelligenz und Werte für das Zusammenleben in der Europäischen Union

Agile Organisation: Werte und Prinzipien als Hebelwirkung

Wirkungstreppe bei Not-for-Profit-Projekten: Output, Outcome und Impact

MCP: Konferenz zu Mass Customization and Personalization im September 2026

In dem Kontinuum der KI-Modelle sind die Übergänge zwischen den Polen fließend. Immer mehr große Modelle bieten daher neben den Closed Models (Proprietäre Modelle) sogenannte Open Weights Modelle an.

OpenAI hat am 05.08.2025 GPT OSS veröffentlicht, das in der kleinsten Version mit 20B z.B. über Huggingface genutzt werden kann. Grundsätzlich erscheint diese Öffnung gut zu sein. Der Beitrag OpenAI Cracks The Door With GPT OSS vom 11.08.2025 geht darauf detaillierter ein. Ich möchte dazu folgende Punkte anmerken:

(1) OpenAI suggerierte bei der Gründung mit dem Namen, dass man sich den Open Source Werten verpflichtet fühlt. Seit 2019 ist OpenAI allerdings vorwiegend ein kommerzielles Unternehmen, das den Firmennamen für geschicktes Marketing nutzt.

(2) Der Modellname GPT OSS weist zunächst darauf hin, dass es sich um Open Source Software (OSS) handelt, was grundsätzlich zu begrüßen ist.

(3) Möglicherweise werden viele GTP OSS mit Open Source AI verwechseln, was möglicherweise auch gewollt ist. Ansonsten hätte das Unternehmen auch einen anderen Namen verwenden können.

(4) Bei GPT OSS handelt es sich nicht um Open Source AI, sondern um einen Open Weight Model: „Among the Big AI companies, attitudes towards openness vary. Some, like OpenAI or Anthropic, do not release any of their models openly. Others, like Meta, Mistral or Google, release some of their models. These models — for example, Llama, Mistral or Gemma — are typically shared as open weights models“ (Tarkowski, A. (2025): Data Governance in Open Source AI. Enabling Responsible and Systemic Access. In Partnership with the Open Source Initiative).

(5) Dabei ist zu beachten, dass man sich mit proprietärer Künstlicher Intelligenz (KI) immer noch die Denkwelt der Eigentümer einkauft.

Siehe dazu auch

Open Source AI: Besser für einzelne Personen, Organisationen und demokratische Gesellschaften

Buyl et al. (2024): Large Language Models Reflect the Ideology of their Creators

Wenn wir uns die Entwicklungen der Künstlichen Intelligenz in der letzten Zeit ansehen, so fällt auf, dass es mehrere Trends gibt.

Neben den dominierenden wenigen großen Large Language Models (LLMs) der Tech-Konzerne gibt es immer mehr kleine Modelle (Small Language Models), die je nach Anwendungsfall ausgewählt werden können. Solche SLM sind flexibler, kostengünstiger und in bestimmten Bereichen sogar besser. Siehe dazu auch KI-Modelle: Von „One Size Fits All“ über Variantenvielfalt in die Komplexitätsfalle?

Weiterhin wird für solche Problemlösungen auch viel weniger Energie benötigt, was die weltweiten, aber auch die unternehmensspezifischen Ressourcen/Kosten schont, Siehe dazu auch Künstliche Intelligenz: Das menschliche Gehirn benötigt maximal 30 Watt für komplexe Problemlösungen.

Darüber hinaus gibt es auch immer mehr leistungsfähige Open Source KI-Modelle, die jedem zur Verfügung stehen, und beispielsweise eher europäischen Werten entsprechen. Siehe dazu auch Das Kontinuum zwischen Closed Source AI und Open Source AI

Wenn also in Zukunft mehr als 1 Milliarde Menschen Künstliche Intelligenz nutzen, stellt sich gleich die Frage, wie Unternehmen damit umgehen. Immerhin war es üblich, dass so eine Art der intelligenten komplexen Problemlösung bisher nur spärlich – und dazu auch noch teuer – zur Verfügung stand.

Nun werden Milliarden von einzelnen Personen die Möglichkeit haben, mit geringen Mitteln komplexe Problemlösungen selbst durchzuführen. Prof. Ethan Mollick nennt dieses Phänomen in einem Blogbeitrag Mass Intelligence.

„The AI companies (whether you believe their commitments to safety or not) seem to be as unable to absorb all of this as the rest of us are. When a billion people have access to advanced AI, we’ve entered what we might call the era of Mass Intelligence. Every institution we have — schools, hospitals, courts, companies, governments — was built for a world where intelligence was scarce and expensive. Now every profession, every institution, every community has to figure out how to thrive with Mass Intelligence“ (Mollick, E. (2025): Mass Intelligence, 25.08.2025).

Ich bin sehr gespannt, ob sich die meisten Menschen an den proprietären großen KI-Modellen der Tech-Konzerne orientieren werden, oder ob es auch einen größeren Trend gibt, sich mit KI-Modellen weniger abhängig zu machen – ganz im Sinne einer Digitalen Souveränität.

Werte spielen in der heutigen Zeit eine bedeutende Rolle. Einerseits bei modernen Arbeitsformen, in denen Werte und Prinzipien eine wichtige Hebelwirkung haben, andererseits sind Werte auch Ordner von sozialer Komplexität.

Gerade in einem so großen Raum wie der Europäischen Union ist es wichtig zu wissen, auf welchen Werten das Zusammenleben basiert. Im Amtsblatt der Europäischen Union 2016/C 202/1 über den Vertrag für die Europäische Union findet man im §2 folgenden Text:

„Die Werte, auf die sich die Union gründet, sind die Achtung der Menschenwürde, Freiheit, Demokratie, Gleichheit, Rechtsstaatlichkeit und die Wahrung der Menschenrechte einschließlich der Rechte der Personen, die Minderheiten angehören. Diese Werte sind allen Mitgliedstaaten in einer Gesellschaft gemeinsam, die sich durch Pluralismus, Nichtdiskriminierung, Toleranz, Gerechtigkeit, Solidarität und die Gleichheit von Frauen und Männern auszeichnet“ (ebd.).

Manchmal habe ich den Eindruck, dass Regionen in der Europäischen Union gerne eigene Werte durchsetzen möchten, sich regional abschotten, aber dennoch die Vorteile der Europäischen Union nutzen wollen. Diese Vorteile gibt es nicht, ohne die Berücksichtigung der genannten Werte – sogar dann, wenn es um die Nutzung der Künstlichen Intelligenz geht. Siehe dazu auch

Bris, A. (2025): SuperEurope: The Unexpected Hero of the 21st Century

Weltweite Übersicht zum Umgang mit Künstlicher Intelligenz

Die Lernzieltaxonomie von Bloom et al. aus dem Jahr 1956 wird heute noch in ihrer ursprünglichen Fassung benutzt, obwohl es schon zeitgemäßere Weiterentwicklungen gibt.

Zunächst einmal ist der Vorschlag von Anderson und Krathwohl aus dem Jahr 2001 zu nennen, bei dem die oberste Ebene in Evaluieren umbenannt wurde, und eine weitere Ebene „Erschaffen“ hinzugekommen ist.

Auf Basis dieser Weiterentwicklung hat die Oregon State University 2024 eine englischsprachige Darstellung unter der Lizenz CC BY-NC 4.0 veröffentlicht, die die jeweiligen Ebenen mit den Möglichkeiten der Künstlicher Intelligenz ergänzt.

Das Trendscouting-Team der PHBern hat die gesamte Übersicht ins Deutsche übersetzt (Abbildung).